4.4 Настройка нейроконтроллера системы управления вертикализацией

Для настройки нейроконтроллера используем вариационный ГА и гибридный Г и их програмное обеспечение, разработанные в разделе 3.

Задаем следующие значения для искусственной нейронной сети - это наличие lслоев, в каждом слое имеется матрица весовых коэффициентов  размерностью

размерностью при этом столбцы матрицы весов

при этом столбцы матрицы весов

первого слоя имеют равно размерность вектора состояний, k1= n, а количество строк матрицы последнего слоя будет равно размерности вектора управления kl= m.

В матрице весов искусственной нейронной сети нами используется три малые вариации выбранной строки матрицы:

a) вариация растяжения,

b) вариация сдвига

c) вариация разворота.

Рассматриваем подробнее малые вариации. Задаем, что

- является выбранной строкой pматрицы Q) на слое r. Операцию растяжения выполним по такому соотношению:

- является выбранной строкой pматрицы Q) на слое r. Операцию растяжения выполним по такому соотношению:

где - это вектор строки матрицы после вариации, а а - это числовой

- это вектор строки матрицы после вариации, а а - это числовой

параметр растяжения, а∈R1.

Операцию сдвига выполним по такому соотношению:

125

где значение β - является числовым параметром сдвига, β ∈R1

Операцию разворота выполним по соотношению:

где значение γ - это параметр разворота,

Считаем дополнительной малой вариацией и замену функции активации  в выбранном слое rвыхода

в выбранном слое rвыхода

Целочисленный вектор из пяти компонент используем для описания малой вариации многослойной НС:

где показателем w1- является номер слоя НС, а w2- это номер вариации,

- вариация растяжения, w2 = 2 - это вариация сдвига, w2= 3 - является вариацией разворота, значение w2 = 4 - является изменением функции активации, а w- является номером строки в матрице выбранного слоя, значение w4- это номер функции активации или номер одной из компонент i1в вариации разворота, значение w5- это номер второй компоненты i2в вариации разворота.

- вариация растяжения, w2 = 2 - это вариация сдвига, w2= 3 - является вариацией разворота, значение w2 = 4 - является изменением функции активации, а w- является номером строки в матрице выбранного слоя, значение w4- это номер функции активации или номер одной из компонент i1в вариации разворота, значение w5- это номер второй компоненты i2в вариации разворота.

Каждое из возможных решений в вариационном ГА определяется конечным упорядоченным множеством векторов вариаций

126

где показатель d- это максимальное количество малых вариаций, на которое может отличаться нейронная сеть любого возможного решения от базисной нейронной сети.

Одновременно с поиском оптимального возможного решения в виде множества (4.31) векторов вариаций при помощи классического генетического алгоритма находим оптимальные значения параметров

Их используем при выполнении вариаций.

Начальное множество возможных решений в Г описывается структурами, которые включают множество векторов вариаций (4.30) и вектор параметров (4.32)

Любое из возможных решение в виде матриц (Q',1,...,Q1,1) многослойной нейронной сети определяют при помощи вариаций базисного набора матриц

При этом значение - является базисной матрицей НС в слое r,

- является базисной матрицей НС в слое r,

Вектор параметров (4.33) в ГА представляется как бинарный код Грея:

127

В нем - является числом бит под целую часть

- является числом бит под целую часть

параметра, а b- это число бит под дробную часть параметра.

Каждое из возможных решений (с учетом представления вектора параметров в коде Грея (4.35)) описывается парой кодов для вариационной и параметрической частей, так:

В Г выполняем операцию скрещивания отдельно для кодов параметрической (4.32) и вариационной частей (4.31) частей отобранных возможных решений

В результате получается два новых возможных решения

После выполнения операций скрещивания (4.37) - (4.40) начинаем выполнение с заданной вероятностью операции мутации для каждого нового возможного решения.

Для этого в вариационных и параметрических частях новых возможных решений случайно определяем

случайно определяемточки мутации и случайно

и случайно

заменяем соответствующие компоненты новых решений:

Оценка решений осуществляется по значениям критерия качества управления (4.22) и точности достижения цели управления (4.23). В процессе обучения находим параметры.

В вычислительном эксперименте использовались следующие параметры генетического алгоритма:

a) число циклов (поколений) - 1000,

b) число возможных скрещиваний в поколении - 512,

c) число поколений между сменой базисного решения - 8,

d) число элитарных возможных решений - 8,

e) параметр для вычисления вероятности скрещивания - 0.4,

f) вероятность мутации - 0.7,

γ) минимальное значение параметра вариаций - -1.57.

В результате получили 5-слойную НС, имеющую следующие параметры:

При каждом вычислении функционала в процессе поиска нейронной сети модель объекта управления интегрировалась улучшенным методом Эйлера второго порядка с шагом интегрирования 0,001 с.

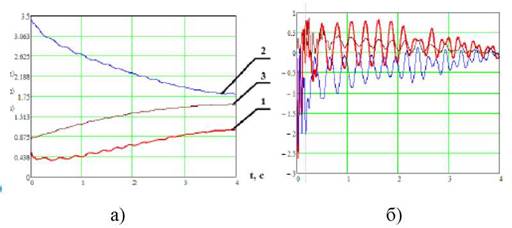

Графики, характеризующие движение системы при данных параметрах нейроконтроллера, представлены на рисунках 4.12, 4.13.

1,2,3 - зависимости .? (рисунок 4.17).

Рисунок 4.17 - Зависимость 12от p ; а) общий вид; б) приближение

В рассмотренном диапазоне параметров ?.• и qвеличину J2 минимизируют

= 3 и :■ = 8 . Построим графики, характеризующие движение системы при данных значениях параметра нейрокотроллера (см. рисунок 4.18).

Рисунок 4.18 - Траектория движения центра масс механизма, 1 - заданная уравнениями (4.14), 2 - полученная для системы с оптимизацией по критерию J2

Сравнивая полученную траекторию с показанными на рисунках 4.15 и 4.16 можно отметить, что оптимизация по J2 позволила устранить тремор и повысить точность отработки заданной траектории в сравнении с системой без

оптимизации. При этом максимальное отклонение центра масс от намеченной траектории по оси О- для системы с нейроконтроллером чем для системы с ПИ- регулятором.

4.5

Еще по теме 4.4 Настройка нейроконтроллера системы управления вертикализацией:

- Синтез нейроконтроллера дляч системы управления вертикализацией экзоскилета

- Разработка методики формирования базы данных для настройки нейроконтроллера экзоскелета

- Синтез системы управления вертикализацией экзоскелета методом искусственных нейронных сетей

- Разработка генетических алгоритмов для синтеза систем управления вертикализацией экзоскелета посредством нейросетевых технологий

- Настройка параметров системы

- Математическая модель для синтеза управления вертикализацией экзоскелета

- Методы и средства нейросетевого управления для вертикализации экзоскелета

- CMS система - Content Menegment System - Система управления содержимым или, проще говоря, система управления сайтом. Это еще у нас в России иногда называют движком сайта. Вещь полезная :)

- Финансовый менеджмент как система управления. Субъекты и объекты управления.

- Финансовый менеджмент как система управления. Место и роль финансового менеджмента в общей системе управления предприятием

- Лекция № 1. Общие сведения о системах автоматического управления и регулирования. Основные принципы управления.

- 67. Система управления — совокупность взаимосвязанных элементов, способ реализации технологии управления, предполагающий воздействие на объект с целью изменения его состояния и процессных характеристик.

- 12. синтаксический уровень языковой системы. Трудные случаи именного и глагольного управления. Управленния при однородных членах предложения. Нанизованиия падежей

- Разработка системы управления экзоскелетом в динамическом режиме

- Генетический алгоритма для обучения нейронной сети для вертикализации экзоскелета с одним критерием оптимизации

- Разработка алгоритма настройки акселерометрических преобразователей

- 12. Социалистические преобразования и ликвидация системы нэпа. Утверждение административно-командной системы управления тоталитарного типа.

- Совершенствование системы управления и государственное регулирование транспортной системы в условиях рыночной экономики